“未見其人,,先聞其聲”,如今在網(wǎng)絡(luò)平臺上,,AI聲音隨處可見,。

隨著算法不斷進步,在高性能設(shè)備和高精度模型的助力下,,AI生成的聲音已從過去的“一聽就假”發(fā)展到如今的 “真假難辨”,。不少有聲讀物采用AI配音,讀者甚至能選擇模仿某個特定人的聲音,,這既降低了成本,,也增添了趣味性。

與此同時,,AI聲音濫用現(xiàn)象也時有發(fā)生,。一些商家在短視頻平臺帶貨時,通過AI模仿知名人士的聲音編造內(nèi)容,,不僅嚴(yán)重誤導(dǎo)了消費者,,也對當(dāng)事人造成了不良影響。

聲音“AI克隆”被濫用

個人的聲紋信息,,作為一種生物識別特征,,具有高度的可識別性,能夠被電子手段精確記錄,。其獨特性,、唯一性及穩(wěn)定性,使其成為將信息與特定自然人相關(guān)聯(lián)的關(guān)鍵要素,。根據(jù)《個人信息保護法》的規(guī)定,,聲紋信息被歸類為敏感個人信息,受到嚴(yán)格保護,。

AI技術(shù)如何生成“以假亂真”的聲音,?記者采訪了解到,,它依賴于當(dāng)下的深度學(xué)習(xí)算法,從采集到的聲音樣本中精確提取一系列關(guān)鍵特征,,包括頻率,、音色、聲調(diào),、語速以及情感表達(dá)等,。隨后,這些特征被轉(zhuǎn)化為復(fù)雜的數(shù)學(xué)模型,,并通過算法進一步合成,,從而生成高度逼真的聲音。

“只需擁有少量的聲音素材,,即可迅速實現(xiàn)聲音的‘AI 克隆’,。”一位不愿透露姓名的技術(shù)人員告訴記者,。

記者在應(yīng)用商店搜索發(fā)現(xiàn),,大量軟件具備相關(guān)功能,一些APP的下載量超千萬次,。記者選擇一款A(yù)PP進行模擬,,只需簡單念出一段文字或輸入音頻片段,這些APP十幾秒即可完成聲音的合成,。

當(dāng)AI生成聲音的門檻迅速降低,,一些不法分子趁機將其濫用于詐騙、虛假宣傳,。社交平臺上,,利用AI技術(shù)模仿并惡搞各領(lǐng)域名人的短視頻屢見不鮮。曾有大量短視頻通過AI模仿某知名人士的聲音,,其中部分視頻包含不當(dāng)言論,,引發(fā)社會熱議。該知名人士隨后發(fā)表視頻回應(yīng),,表示這些事件給自己帶來了困擾和不適,,呼吁大家停止此類行為。

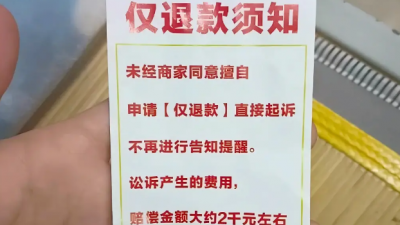

此外,,一些商家在短視頻平臺帶貨時,,利用AI生成聲音誤導(dǎo)消費者。

擅自將他人聲音AI化不合法

在2024年公布的我國首例AI生成聲音人格權(quán)侵權(quán)案中,,原告殷某是一名配音演員,,他意外發(fā)現(xiàn)自己的聲音被AI化后,,在被告某智能科技公司運營的平臺中對外出售,。隨后殷某將該智能科技公司等被告起訴,,主張被告的行為嚴(yán)重侵犯了自身的聲音權(quán)益。

法院審理認(rèn)為,,利用人工智能合成的聲音,,如果能使一般社會公眾或者相關(guān)領(lǐng)域的公眾根據(jù)其音色、語調(diào)和發(fā)音風(fēng)格,,關(guān)聯(lián)到該自然人,,即可認(rèn)定為具有可識別性。因此,,某文化傳媒公司,、某軟件公司未經(jīng)原告許可AI化使用了原告聲音,構(gòu)成對原告聲音權(quán)益的侵犯,,應(yīng)承擔(dān)相應(yīng)的法律責(zé)任,。

對于此案,北京互聯(lián)網(wǎng)法院副院長,、二級高級法官趙瑞罡認(rèn)為,,我國民法典將人格權(quán)獨立成編,首次以立法形式將保護“聲音”寫入民法典,,明確參照適用肖像權(quán)的形式保護自然人的聲音,。聲音作為一種人格權(quán)益,具有人身專屬性,,任何自然人的聲音均應(yīng)受到法律的保護,,對錄音制品的授權(quán)并不意味著對聲音AI化的授權(quán),未經(jīng)權(quán)利人許可,,擅自使用或許可他人使用錄音制品中的聲音構(gòu)成侵權(quán),。

隨著AI技術(shù)在各個領(lǐng)域的廣泛應(yīng)用,由AI技術(shù)引發(fā)的糾紛日漸增多,。在中國裁判文書網(wǎng)上,,記者搜索到不少侵害作品信息網(wǎng)絡(luò)傳播權(quán)的案件中包含聲音AI使用等關(guān)鍵詞。

對此,,河北厚諾律師事務(wù)所律師雷家茂表示:“個人未經(jīng)他人允許擅自將他人聲音AI化不合法,,侵犯了他人的合法權(quán)益,權(quán)利人有權(quán)依法維權(quán),。根據(jù)民法典第一千零二十三條規(guī)定,,對自然人聲音的保護,參照適用肖像權(quán)保護的有關(guān)規(guī)定,,可以要求侵權(quán)人停止侵害,、賠禮道歉、賠償損失等?!?

治理應(yīng)多措并舉,、標(biāo)本兼治

當(dāng)下,與AI換臉視頻相比,,AI合成語音更難辨別,、門檻更低。一個“聲音很熟的電話”可能是詐騙,。

2月21日,,中央網(wǎng)信辦發(fā)布2025年“清朗”系列專項行動整治重點,特別提到整治AI技術(shù)濫用亂象,,突出AI技術(shù)管理和信息內(nèi)容管理,,強化生成合成內(nèi)容標(biāo)識,打擊借AI技術(shù)生成發(fā)布虛假信息,、實施網(wǎng)絡(luò)水軍行為等問題,,規(guī)范AI類應(yīng)用網(wǎng)絡(luò)生態(tài)。

“聲音作為一種人格權(quán)益,,具有人身專屬性,。我國已在現(xiàn)有法律框架中對聲音權(quán)益保護做出了一定規(guī)定?!崩准颐硎?,“AI生成聲音的過程中,涉及聲音樣本的采集,、使用,、算法的研發(fā)和應(yīng)用等多個環(huán)節(jié),每個環(huán)節(jié)都可能涉及不同主體的權(quán)益,。要進一步完善法律體系,,細(xì)化AI克隆技術(shù)的法律條款,明確侵權(quán)行為的定義和責(zé)任,,加強執(zhí)法力度,。”

有專家表示,,對于濫用AI“偷”聲音的亂象應(yīng)多措并舉,、標(biāo)本兼治。平臺層面要切實履行監(jiān)管責(zé)任,,建立健全對AI聲音的審核和侵權(quán)舉報機制,,及時發(fā)現(xiàn)和攔截侵權(quán)、虛假,、違法等不良內(nèi)容,。相關(guān)部門應(yīng)繼續(xù)加大對利用AI技術(shù)進行詐騙等違法犯罪行為的打擊力度,,形成更加完善的常態(tài)化治理機制。

此外,,雷家茂提示,,在AI技術(shù)日益普及的時代,個人也必須加強對個人生物特征信息,,特別是聲音的保護意識。不輕信或傳播未經(jīng)核實的AI生成聲音信息,,以防被誤導(dǎo)或卷入不必要的風(fēng)險,。(工人日報記者 周子元)《工人日報》(2025年02月24日 01版)

編輯:鳴笛

“護眼臺燈”亂象調(diào)查

“護眼臺燈”亂象調(diào)查 AI賬號成起號新套路 多手段繞過“AI打標(biāo)”背后有哪些隱患?

AI賬號成起號新套路 多手段繞過“AI打標(biāo)”背后有哪些隱患? 救命的醫(yī)療設(shè)備,如何淪為個人提款機,?

救命的醫(yī)療設(shè)備,如何淪為個人提款機,? 原價上千元“貴婦霜”網(wǎng)店賣不到百元

原價上千元“貴婦霜”網(wǎng)店賣不到百元